技術文章

近年來,伴隨自動駕駛技術的快速發展,行業對于仿真測試平臺的精度、覆蓋率和可擴展性提出了更高要求。尤其在數據閉環迭代、長尾場景驗證及安全冗余驗證等關鍵環節中,高保真、高復雜度的場景生成能力正在成為測試體系的核心支撐。

傳統場景生成方式面臨效率低、人工成本高、行為多樣性不足等問題,難以滿足當前智能駕駛系統對大規模、多模態、真實物理驅動場景的需求。為應對這一挑戰,基于生成式AI的4D場景生成技術迅速興起,構建了從環境建模、行為重建到視覺渲染的完整鏈條,正在重塑自動駕駛仿真驗證的技術基礎。

本文將從技術背景、系統能力、核心技術和實際應用四個方面,系統梳理AI驅動的4D場景生成體系及其在自動駕駛仿真中的實踐價值。

自動駕駛測試需要應對極其復雜的交通場景,包括非結構化路口、弱交通規則區域、罕見天氣、低照度場景,以及多主體交互引發的不確定性行為等。當前基于真實數據采集或手工建模的方式存在如下限制:

(1)采集成本高:依賴實車、實景、多模態同步設備,周期長、數據稀疏;

(2)稀有場景不足:事故場景、異常行為等真實比例極低,難以高質量復現;

(3)組合爆炸問題:參數空間(如天氣、時間、交通密度)指數級增長,難以人工覆蓋;

(4)場景可控性弱:缺乏可調控的語義接口,測試粒度不足。

生成式AI具備從數據中學習潛在分布、生成新組合樣本的能力。其引入使得場景構建從“手工定義"轉向“自動生成",具備如下優勢:

(1)能構造真實但未見過的長尾組合;

(2)能對目標測試策略進行定向增強(如遮擋率、交通密度等指標);

(3)可支持大規模仿真測試平臺的持續供場;

(4)支持動態交互與時間演進建模,構建完整4D語義閉環。

所謂4D場景生成,核心在于“空間 + 時間"的聯合建模能力,既要對物理環境建模,也要對場景中各類參與者的行為軌跡進行動態建模與演化。典型的系統能力包括:

(1)幾何/語義重建能力:生成準確的道路、建筑、交通設施等結構化環境,并附帶完整語義標簽;

(2)多主體行為建模能力:生成車輛、行人、非機動車的時序軌跡,滿足行為邏輯與交互合理性;

(3)高保真視覺建模能力:輸出具備真實紋理、光照與傳感器特性的圖像序列;

(4)物理一致性約束能力:保持交通規則、實體尺寸、運動學約束等基本物理一致性;

(5)模態可控能力:支持控制場景的天氣、時間、視角、密度、行為模式等關鍵參數。

在不同技術路徑中,上述能力往往由多個模塊聯合實現,從數據驅動的軌跡預測模型,到神經渲染網絡,再到多模態融合仿真接口,共同構成完整的4D場景生成流水線。

NeRF是一種基于神經網絡的體積渲染方法,通過對空間點位置與觀察方向的編碼,學習輸出每個點的顏色與密度,實現高質量的三維重建與新視角圖像合成。

(1)技術特點

- 具備很高的渲染保真度;

- 支持任意視角合成,適用于多視圖重建任務;

- 對遮擋、反射、透明等復雜視覺效果建模能力強。

(2)局限性

- 訓練效率低,渲染速度慢;

- 不原生支持動態場景;

- 依賴多視角密集數據輸入。

NeRF更適合作為小規模高精重建模塊,用于城市局部區域或典型交互區域建模。

EmerNeRF的自動駕駛場景重建真值/渲染值對比

3D Gaussian Splatting 是近年來提出的高效神經渲染方法,由 Inria 團隊于 2023 年發布。它采用高斯分布建模離散點云,在屏幕空間進行潑濺(splatting)操作,從而實現對三維場景的實時渲染。不同于 NeRF 使用體積積分的方式,3DGS 將空間中的顏色和密度建模為可渲染的高斯球體,渲染效率顯著提升。

其主要優勢包括:

(1)很高的渲染效率:相比 NeRF 快數百倍,可實現實時或近實時的圖像合成;

(2)訓練速度快:幾十秒到幾分鐘即可完成一個中等規模場景的建模;

(3)結構緊湊,易于部署:渲染結構不依賴深度網絡推理,適合本地仿真引擎嵌入;

(4)視覺質量優異:保留了 NeRF 的軟陰影、光照過渡與遮擋關系等特性。

在自動駕駛仿真系統中,3DGS 可用于從多視角圖像或視頻中重建真實道路場景,為感知模型提供高保真圖像合成能力,適用于傳感器回放、虛擬重構、數據增強等場景,是當前神經渲染領域中效率與質量兼具的重要方案之一。

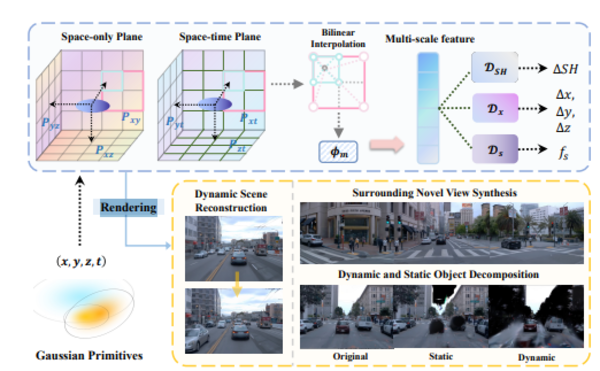

基于3DGS的S3Gaussian算法提出的重建流程

log2world是一種將自動駕駛原始數據(如ROS bag、CAN log、傳感器幀)自動轉化為可視、可交互仿真場景的工具鏈。主要功能包括:

(1)根據IMU與GNSS數據還原車輛軌跡;

(2)使用圖像與點云重建環境幾何與紋理;

(3)提取行為序列并重建動態參與者;

(4)輸出統一格式場景文件,支持仿真平臺直接加載(如Unreal、CARLA、LGSVL等)。

log2world顯著降低了真實場景數字化與復現成本,是構建基于真實行為數據的4D測試場景的重要手段。

用于Log2World仿真的流程示例(IVEX+aiSim)

生成式AI+4D場景生成技術目前已在以下典型場景中形成落地:

(1)閉環驗證系統:自動識別模型薄弱場景,動態生成補全,形成仿真-訓練-驗證閉環;

(2)多模態數據生成引擎:結合仿真接口輸出RGB圖像、深度圖、點云、語義標簽等,用于感知模型訓練;

(3)長尾用例擴增:生成特定條件組合下的稀有事件,如夜間施工、交通事故、人車混行等;

(4)仿真平臺集成:與CARLA、Unreal、aiSim等平臺對接,作為自動構圖/行為驅動模塊使用;

(5)城市級數字孿生:快速還原城區典型路段結構及交通特征,支持區域智能交通仿真與決策測試。

未來,隨著大模型融合語義驅動生成(如Prompt-to-Scene)、行為軌跡生成器與語義控制接口集成、生成內容與實車反饋協同優化機制的發展,AI生成的4D場景將成為自動駕駛數據體系中的基礎設施,為模型迭代、安全驗證與持續運營提供核心支撐。

4D場景生成技術正從研究階段走向規模應用,構建出兼顧真實性、復雜性與效率的場景生成能力,是實現自動駕駛系統仿真閉環與持續優化的關鍵引擎。

生成式AI正逐步承擔起從世界建模者到智能驗證者的角色,其影響力正在由測試階段擴展至研發、訓練、部署等完整流程。可以預見,未來的自動駕駛系統開發,將越來越依賴于這一類“生成驅動的智能仿真基礎設施"。

▍參考文獻

1. EmerNeRF: Emergent Spatial-Temporal Scene Decomposition via Self-Supervision

2. S3Gaussian: Self-Supervised Street Gaussians for Autonomous Driving

關注微信

關注微信